De nombreuses publications indiquent que l’Union européenne va bientôt scanner tous les contenus échangés sur les plateformes numériques. À travers un projet de directive européenne surnommé Chat Control, les citoyens européens seraient exposés à une surveillance de masse. L’initiative vise à lutter contre la pédocriminalité en ligne mais elle est contestée et suscite de vifs débats car sa mise en pratique implique des risques de dérives. La version actuelle du projet ne vise cependant pas toutes les conversations et fichiers mais uniquement les échanges d’images. Des garde-fous sont également prévus dans le projet actuel, qui pourrait encore évoluer.

Depuis quelques semaines, de nombreuses publications sur les réseaux sociaux évoquent le projet « Chat Control ».

« Dans quelques mois chaque message que vous enverrez, chaque photo, chaque vidéo pourra être lu avant même d’arriver à son destinataire. Votre téléphone, votre ordinateur deviendront des outils de surveillance » indique un internaute sur TikTok. Il ajoute : « Nos messages et photos seront bientôt scannés et traités par un algorithme avec la loi Chat Control. »

« Tous vos messages, photos, fichiers bientôt scannés avant envoi et signalés aux autorités » indique une autre publication sur TikTok mise en ligne le 11 août 2025 et qui cumule plus de 110.000 vues depuis sa mise en ligne. « Nos messages et photos seront bientôt scannés et traités par un algorithme avec la loi Chat Control. »

« Chat Control : avec cette loi, l’Europe lira TOUS vos messages ». C’est le texte qui illustre une publication de Florian Phillipot qui a fait plus de 160.000 vues sur TikTok.

Le président du parti français « Les Patriotes » explique dans cette vidéo que tous les messages des citoyens seront scannés pour « vérification officiellement qu’il n’y a pas pédopornographie ou terrorisme, ça, c’est l’argument officiel ». Il évoque également « le plus grand outil de surveillance de masse jamais inventé ».

Sur Instagram, d’autres publications virales (1, 2) évoquent « Chat Control » et cumulent des millions de vues. « Dans un mois, l’Europe va voter une loi qui permettra aux gouvernements de scanner tous nos messages privés. WhatsApp, Messenger, Signal, tout y passe. Ce projet s’appelle Chat Control. Il s’appuie sur une intelligence artificielle qui va fouiller tout ton téléphone, lire tes messages, tes photos, tes vidéos » indique une créatrice de contenu spécialisée dans l’IA dans un post du 12 septembre 2025. Dans cette vidéo qui a fait plus de 3,4 millions de vues elle indique également « avec cette loi, tout le monde est suspect » et que « chacun finira par se censurer parce qu’on saura qu’une intelligence artificielle lit tout ».

Des sites et des pétitions en ligne pour s’opposer au projet

Plusieurs pages et des pétitions (1, 2) sont présentes en ligne. « Stop Chat Control« , « Stop Chat Control EU » ou encore « Fight Chat Control » comptent parmi les portails qui s’opposent au projet européen.

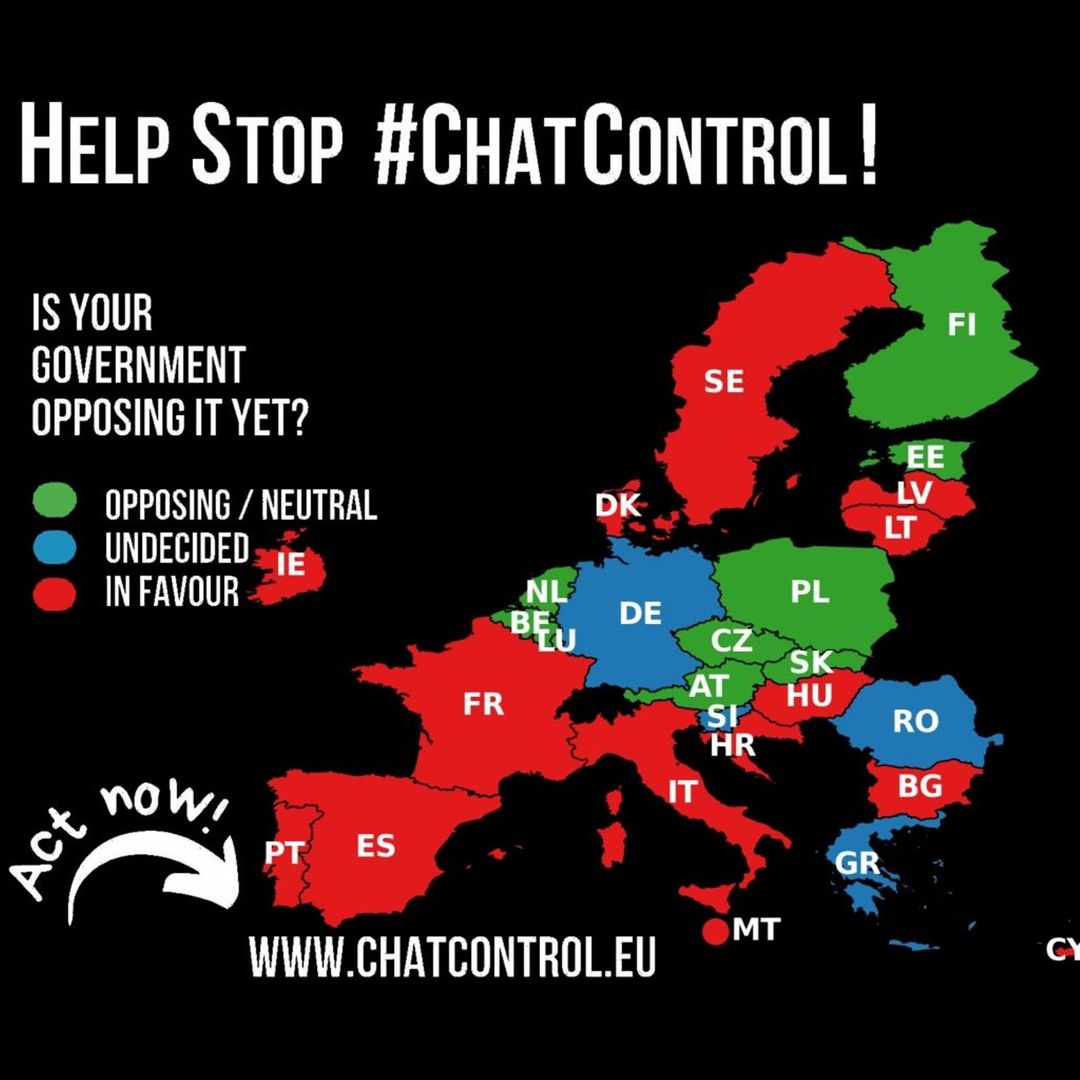

Il y a également un député européen allemand qui a une page dédiée à Chat Control. Sur cette page, le député du Parti des pirates publie notamment une carte de l’Union européenne avec le positionnement des différents pays. Ceux qui seraient en faveur du texte sont indiqués en rouge (14 pays), les indécis en bleu (4) et les opposés / neutres en vert (9). La dernière version de cette page indique que la Belgique est reprise dans les « opposés « .

Cette carte circule de façon très large à travers différentes versions sur les plateformes en ligne.

© Site de Patrick Breyer / Carte publiée représentant le positionnement supposé des différents pays de l’UE sur le projet CSAM, le 19 septembre 2025.

Le CSAM : un texte qui vise à lutter contre l’échange de contenu pédopornographique en ligne

« Chat Control » (ndlr : contrôle des discussions en français), parfois aussi dénommé « Chat Control 2.0 » est le surnom donné par ses détracteurs à la proposition de règlement européen CSAM (Child Sexual Abuse Material, ou matériel relatif aux abus sexuels sur les enfants en français) qui vise à lutter contre la diffusion de contenus pédopornographiques.

Des mesures européennes sont déjà en place pour tenter de contrer ce phénomène de distribution de photos et de vidéos illégales d’enfants notamment via l’autorisation accordée à certaines entreprises d’utiliser des technologies qui permet de détecter l’échange de ce type de contenus sur leurs plateformes. Les dispositions actuelles ont été prolongées jusqu’en avril 2026. Mais le projet actuellement sur la table souhaite aller plus loin.

Depuis mai 2022, la Commission européenne souhaite mettre en place un système qui obligerait les plateformes à scanner les contenus échangés en amont de leur diffusion sur les plateformes en lignes, qu’elles soient cryptées ou non, afin de lutter contre la circulation de contenus pédocriminels.

L’idée générale est que les plateformes devraient vérifier si des photos ou vidéos issues de bases de données contenant des contenus pédopornographiques déjà identifiés circulent sur leurs réseaux et, dans le cas où les machines les détecteraient, d’en bloquer immédiatement la diffusion. Le projet prévoit également l’obligation de vérifier l’âge des utilisateurs par les plateformes.

Un projet qui n’est pas neuf mais qui revient dans l’actualité

Les propositions de texte pour tenter de lutter contre la diffusion de ces contenus illégaux via les plateformes ont déjà connu de nombreuses évolutions ces dernières années, avec notamment le retrait de l’ordre du jour en juin 2024 d’un vote sur une version du projet lors de la présidence belge du Conseil de l’Union européenne.

Mais si le « CSAM » fait à nouveau parler de lui, c’est parce qu’il a été remis à l’ordre du jour du Conseil de l’UE, sous la présidence du Danemark depuis le 1er juillet.

Le texte soulève de nombreuses questions et suscite énormément de réactions ainsi qu’un débat entre les promoteurs d’une lutte plus efficace contre la diffusion des contenus à caractères pédopornographiques et les défenseurs du respect de la vie privée.

La dernière version de ce texte de « Proposition de règlement du Parlement européen et du Conseil établissant des règles pour prévenir et combattre les abus sexuels commis sur des enfants », amendée et portée par la présidence danoise, date du 24 juillet 2025 et est disponible en anglais sur le site du Conseil de l’UE.

La question de la technologie utilisée

Cette volonté de mieux contrôler et de lutter contre les échanges de contenus à caractère pédopornographique repose sur une question technique majeure. Comment peut-on analyser des millions de données partagées via des messageries mais aussi les chats proposés par les réseaux sociaux, les e-mails ou les applications de visioconférences ?

Se pose aussi particulièrement la question des applications de messagerie chiffrées (ndlr : cryptées) par défaut comme WhatsApp, Signal ou Telegram qui sont utilisées par des millions d’utilisateurs de smartphones.

Pour contourner le chiffrage des contenus, la technologie actuellement envisagée est celle du « client-side scanning » (ndlr : scan côté client en français). Il s’agit d’une technique qui consiste à analyser le contenu d’un message sur l’appareil de l’utilisateur avant qu’il ne soit envoyé, à la recherche de contenu répréhensible ou de correspondances avec une base de données de contenus interdits. En d’autres termes, le scan est effectué depuis l’appareil de l’utilisateur avant que le message ne soit transmis au destinataire, et potentiellement avant qu’il ne soit chiffré, s’il l’est. Les éventuelles correspondances peuvent être alors comparées via des algorithmes avec des bases de données existantes.

« C’est comme si on envoyait une lettre dans une enveloppe scellée et qu’une caméra regardait d’abord ce qu’on y a mis avant de la fermer », image Anne Canteaut, directrice de recherches à l’Inria, spécialisée en sécurité de l’informatique au média 20 minutes. Les messageries chiffrées garantissent que seuls l’expéditeur et le destinataire peuvent lire un message. La solution technologique implique qu’il y aurait « un algorithme installé sur le téléphone ou l’ordinateur pour vérifier le contenu », poursuit-elle. « On ne casse pas le chiffrement mais on impose un scanning côté client : on n’ouvre pas la lettre fermée, on la regarde avant de fermer l’enveloppe. »

La proposition actuelle réintroduit aussi la possibilité d’utiliser du « machine learning » et l’intelligence artificielle pour détecter également des images CSAM inconnues.

Le chiffrement des contenus menacés : des sociétés et des académiques réagissent

Cette nouvelle technique qui permettrait le contournement du chiffrement des contenus suscite l’émoi de nombreux experts en matière de sécurité et de protection de la vie privée.

Des entreprises directement concernées ont indiqué qu’elles refuseraient de collaborer si le texte est adopté en l’état. C’est le cas de la messagerie chiffrée Signal, dont la présidente a menacé en mai 2024 de se retirer du marché européen. Proton, la société suisse derrière Proton Mail et Proton Drive, estimait de son côté en septembre 2023 que le projet « ne peut pas marcher », qu’il est « incompatible avec le respect du chiffrement de bout en bout » et qu’elle envisageait des actions légales si le cryptage de ses services était menacé.

Dans une publication parue en avril 2023, des membres de l’Université française Sciences Po indiquait en conclusion : « La proposition de l’UE visant à prévenir et à combattre les abus envers les enfants en filtrant les messages privés est bien intentionnée. Cependant, en l’état actuel des technologies, il serait impossible d’appliquer la réglementation sans affaiblir ou éliminer le chiffrement de bout en bout sur les plateformes de messagerie en ligne. Les avantages collectifs du chiffrement pour la vie privée, la confiance et la démocratie pourraient l’emporter sur les risques liés à la création d’un bouclier pour les pédophiles, les terroristes ou autres criminels, qui trouveront d’autres moyens de commettre leurs crimes ».

Pour les autrices du document : « L’UE pourrait envisager des politiques visant à prévenir le CSAM, ainsi que des propositions techniques qui protégeraient l’intégrité du cryptage sans créer de portes dérobées ou de vulnérabilités pouvant être exploitées par des pirates informatiques ».

Des préoccupations concernant le respect de la vie privée

Au-delà de l’aspect purement technique sur l’encryptage, des experts mettent en évidence le fait que la technologie envisagée pose plusieurs défis et questions éthiques car elle peut potentiellement entraîner un risque de surveillance généralisée si elle est détournée ou mal encadrée et ouvre aussi la porte à des abus institutionnels ou criminels ainsi que des risques de failles informatiques.

Les détracteurs craignent également un possible « glissement fonctionnel » : une fois qu’un système permettant de scanner tous les messages des utilisateurs sera en place, de futurs gouvernements pourraient être tentés d’étendre son champ d’application à d’autres domaines, tels que le terrorisme, le respect des droits d’auteur ou la dissidence politique.

Ils pointent également un risque de « faux positifs » avec, par exemple des images qui pourraient être identifiées comme des contenus pédopornographiques alors qu’elles ne le sont pas.

Le 9 septembre 2025, des acteurs du monde académique ont publié une lettre à destination du Parlement et du Conseil européen afin de mettre en doute la faisabilité technique du projet et de mettre en garde contre les risques de cette « détection à partir de l’appareil », dénonçant des risques pour la sécurité et la vie privée des citoyens européens. Cette lettre a recueilli plus de 700 signatures en date du 18 septembre.

Pour le co-initateur de cette lettre, Bart Preneel, professeur de cryptographie et de sécurité informatique à la KU Leuven, interrogé par Data News, l’initiative danoise passe à côté de l’essentiel. Le Belge estime que « de petites améliorations, comme des notifications plus rapides, ne suffisent pas à atténuer les risques structurels pour la vie privée. »

L’Autorité de protection des données émet de « sérieux doutes »

En Belgique, l’Autorité de protection des données (APD) indique suivre « de près les développements concernant la proposition de règlement et veillera à tout moment à ce qu’une balance équilibrée soit trouvée entre d’une part, la protection des mineurs et, d’autre part, le droit au respect de la vie privée, à la confidentialité des communications (électroniques) et à la protection des données à caractère personnel ».

« Le règlement CSAM étant un règlement européen, l’EDPB, dont l’APD est donc membre, suivra le projet. Nous serons donc probablement à nouveau amenés à nous prononcer aux côtés de nos homologues européens », indique la porte de l’autorité à la RTBF.

En 2022, l’EDPB qui est l’organisme européen qui regroupe les représentants des autorités de protection de données des pays européens, y compris l’autorité belge, s’était positionnée aux côtés de l’EDPS (l’autorité chargée de la protection des données au niveau de l’UE) en indiquant que la proposition qui était discutée à l’époque soulevait « de graves préoccupations en matière de protection des données et de respect de la vie privée » et invitait les colégislateurs « à modifier la proposition de règlement, notamment pour veiller à ce que les obligations de détection envisagées respectent les normes applicables en matière de nécessité et de proportionnalité et n’entraînent pas un affaiblissement ou une dégradation du chiffrement à un niveau général ».

« Dans l’attente de cette nouvelle prise de position commune officielle, nous pouvons cependant indiquer que nous avons de sérieux doutes quant à la nouvelle proposition », indique encore l’APD.

Des associations et des experts dans la lutte contre la pédocriminalité soutiennent la proposition

Du côté des partisans du projet, il y a notamment des associations qui sont actives dans la lutte contre l’exploitation sexuelle d’enfants et des experts dans la lutte contre la pédocriminalité.

Aujourd’hui, des dispositions existent pour lutter contre le phénomène mais pour certains experts, elles se révèlent insuffisantes. « Les contenus pédopornographiques qui circulent qui ne sont pas tous détectés, la réglementation est très axée sur le retrait des contenus par la justice une fois qu’ils ont été identifiés », explique Guillaume Desgens, magistrat et professeur associé au Conservatoire national des arts et métiers aux vérificateurs de TF1. « On court après les contenus, et ce n’est pas très efficace », déplore l’expert.

Child Focus, la Fondation pour enfants disparus et sexuellement exploités, soutien pleinement la proposition danoise. Selon elle, « le volume d’images d’abus sexuels d’enfants croît de façon exponentielle, y compris sur les réseaux sociaux que vous et moi utilisons, et cela notamment en raison des services de messagerie chiffrée » et insiste sur la « nécessité d’agir ».

Selon Child Focus, « la technologie est également suffisamment avancée pour être efficace, surtout pour détecter non seulement des images déjà connues mais aussi de nouvelles images d’abus sexuels sur enfants. Il existe aujourd’hui déjà des technologies éprouvées capables de détecter avec une grande fiabilité de nouvelles images d’abus sexuels sur mineurs ».

Tijana Popovic, conseillère politique de la fondation, estime qu’il est « extrêmement urgent que cette réglementation voie le jour, sinon nous tombons dans un vide juridique où même la détection volontaire par les plateformes ne sera plus possible. Beaucoup d’auteurs, qui se tournaient auparavant vers le dark web, se sentent désormais en sécurité sur des applications encryptées comme Telegram ou WhatsApp. Nous estimons également que le projet de résolution n’est pas disproportionné ».

La conseillère politique de la fondation estime également que le terme de « Chat Control » n’est pas approprié car le texte « ne concerne que les contenus visuels et non pas le contrôle des discussions ni l’analyse de textes. L’utilisation du terme « Chat Control » est donc erronée : il n’est nulle part question de contrôle des conversations privées ».

« La proposition contient par ailleurs suffisamment de garanties pour protéger la vie privée des utilisateurs. Ne devrait-on pas aussi accorder de l’attention au droit à la vie privée de tous ces enfants victimes d’abus sexuels dont les images continuent à circuler ? », interroge Mme Popovic.

Un cadre et des « garde-fous » prévus

Le texte qui fait 201 pages est actuellement discuté au sein des États membres de l’UE. Il prévoit effectivement différents garde-fous. Le mot « safeguard » apparaît 47 fois dans la proposition.

Parmi ceux-ci, la mise en place d’un centre d’expertise européen dédié à la lutte contre les abus sexuels sur les enfants (Article 40/1) qui servirait de cadre à l’application de la législation, dénommé dans le texte en anglais par l’appellation « EU Centre ». Le Conseil d’administration de ce centre serait composé d’un membre de chaque pays de l’UE ainsi que d’un représentant de la Commission ainsi qu’un expert indépendant désigné par le Parlement européen (mais ce dernier n’aurait pas de droit de vote).

Les contenus potentiellement détectés d’abord anonymisés puis traitée par un humain

Ce « Eu Centre » fonctionnerait comme centre de tri et donc comme un intermédiaire. Ni l’UE, ni les États membres, ni la police ne recevraient directement les données en cas de détection d’un contenu pédopornographique.

Dans le cas où un contenu serait identifié, il serait anonymisé avant de faire l’objet d’une vérification humaine. Le centre d’expertise évaluera ensuite s’il s’agit bien d’images manifestement illégales. Si tel est le cas, un ordre de détection pourrait alors être délivré pour le service spécifique d’une plateforme de façon limitée dans le temps et uniquement avec une technologie certifiée par ce centre d’expertise part des tribunaux ou des autorités indépendantes.

Une technologie qui doit être certifiée par le centre d’expertise

Concernant la technologie utilisée par les plateformes pour implémenter le texte, celle-ci devrait d’abord faire l’objet d’une certification par le centre d’expertise de l’UE. Une technologie qui n’est pas jugée suffisamment avancée ne reçoit pas de certification. Par ailleurs, le texte indique que « aucune disposition du présent règlement ne devrait être interprétée comme interdisant, affaiblissant ou contournant le chiffrement de bout en bout, exigeant sa désactivation ou le rendant impossible ».

Le texte prévoit le scan uniquement des images, à ce stade

Autre élément important qui a été pris en compte dans la dernière proposition danoise, le scan des contenus ne concernerait que les images : photos, vidéos et URL. Les messages texte et audio ne seraient donc à ce stade plus scannés ce qui entraîne de facto la pertinence de l’appellation par ses opposants de « Chat Control ». Cependant, le document juridique, stipule « que le texte et l’audio pourraient être ajoutés ultérieurement ».

Qu’en est-il maintenant ?

Le 12 septembre dernier, les 27 États membres de l’UE ont eu l’occasion de finaliser leurs évaluations de la dernière version de la proposition danoise et de clarifier leurs positions lors de l’examen du texte.

Le prochain débat sur ce projet au sein du Conseil de l’Europe devrait avoir lieu les 13 et 14 octobre prochains au sein du Conseil de Justice et des Affaires intérieures. Pour que le projet poursuive son chemin, au moins 55% des États membres doivent s’exprimer en faveur : cela correspond à 15 États sur 27. Les États membres qui soutiennent la proposition doivent également représenter au moins 65% de la population de l’UE.

Plusieurs pays ont déjà exprimé clairement leurs positions par rapport au texte comme la France, l’Espagne et l’Italie, qui soutiennent actuellement la proposition. Selon les détracteurs du projet comme Patrick Breyer et « Fight Chat Control », ils seraient actuellement une majorité, soit 14 sur 27, à être en faveur. Neuf pays, dont les Pays-Bas, le Luxembourg, l’Autriche et la Pologne, ont déclaré qu’ils ne pouvaient accepter la loi dans sa forme actuelle, tandis que quatre États membres resteraient encore indécis.

La Belgique apparaît comme opposée au texte dans la plupart des publications. La N-VA a indiqué qu’elle voterait contre alors que d’autres eurodéputés belges (Les Engagés/Renew, Ecolo/Les Verts) se disent aussi, a priori, également contre.

Mais les clefs de ce texte pourraient être entre les mains de l’Allemagne dont la position longtemps « défavorable » au projet est devenue ensuite jugée « favorable » pour devenir « indécise » récemment. Le 10 septembre la commission des affaires numériques allemande mettait en évidence le fait que l’Allemagne devait encore ajuster sa position. En raison de son poids démographique (ndlr : +- 19% de la population de l’UE) sa position devrait être déterminante dans ce premier vote.

Si l’Allemagne rejoint finalement les pays opposés au texte, il pourrait donc y avoir assez de voix pour bloquer le CSAM. Si le texte est néanmoins adopté en octobre, il devrait ensuite continuer son chemin législatif avec une phase de conciliation appelée trilogue. Tout accord éventuel devra ensuite être adopté par le Conseil et le Parlement, ce qui signifie qu’il y aura effectivement un autre vote au Parlement européen. S’agissant du calendrier, l’attachée de presse du Parlement européen indique à la RTBF qu’il leur est impossible de se prononcer pour le moment.

Un débat vigoureux et de la désinformation

Le CSAM, surnommé « Chat Control » par ses opposants, fait l’objet de nombreuses publications sur les réseaux sociaux et suscite de nombreux débats sur le respect de la vie privée, les risques de faille de sécurité ou de dérives antidémocratiques. Le texte est soutenu par différentes organisations qui estiment cependant que la proposition est équilibrée et que le texte remplit un objectif légitime de lutte contre la circulation d’images pédopornographiques.

Les affirmations qui indiquent qu’un contrôle de masse de la population sera bientôt mis en place sont trompeuses.

Tout d’abord, la proposition est encore en cours d’examen dans le cadre du processus législatif de l’UE et il est tout à fait possible qu’il fasse encore l’objet de modifications ou qu’il ne passe pas le cap du Conseil européen prévu en octobre prochain. Après cette étape, le Parlement européen devrait encore se positionner. S’il ne vote pas en faveur du texte il serait recalé.

S’il est voté par une majorité des députés européens, il n’est par ailleurs pas exclu que des recours vers des instances judiciaires européennes soient introduits pour faire annuler le règlement.

Dans le cas où le texte aboutirait dans sa forme actuelle et serait appliqué, les garde-fous prévus prévoient que seules les images (vidéos, photos et URL) seront analysées. Le cadre du centre d’expertise qui serait en charge du CSAM ne prévoit pas d’étendre son champ d’action à d’autres thématiques comme la lutte contre le terrorisme, par exemple.

Par ailleurs, les ordonnances de détection nécessiteraient toujours une autorisation au cas par cas de la part des tribunaux ou d’autorités indépendantes, et seraient limitées dans le temps.