Depuis le début de l’attaque des États-Unis et d’Israël contre l’Iran le 28 février 2026, de nombreuses publications se servent de ce contexte de guerre pour tenter de tromper les utilisateurs de réseaux sociaux. Souvent aidés par des outils d’intelligence artificielle générative, des créateurs de contenus amplifient ou créent des situations en surfant sur la peur pour générer des vues ou tenter d’influencer l’opinion publique. En voici quelques exemples.

L’essor de l’IA générative a démultiplié la capacité des États, des propagandistes et de créateurs de contenus opportunistes à la recherche de « likes » et de « vues ». Ces outils devenus accessibles au grand public sont aujourd’hui utilisés lors de conflits majeurs pour créer des photos et ces vidéos de plus en plus convaincantes. Cette tendance comporte de véritables implications en matière de sécurité, soulignent des chercheurs.

La journaliste de BBC Verify Shayan Sardarizadeh, qui couvre et publie en direct et en ligne sur la guerre afin de démystifier les fausses informations et de vérifier les images réelles, déclarait le 4 mars, cinq jours à peine après le début de l’attaque des États-Unis et d’Israël sur l’Iran que « cette guerre pourrait déjà avoir battu le record du plus grand nombre de vidéos et d’images générées par l’IA qui sont devenues virales pendant un conflit ».

Cet article vise à référencer un certain nombre de ces fausses informations ou détournements, parmi les plus viraux, que nous avons pu analyser à travers notre cellule de fact checking, Faky. Il se base aussi sur le travail d’autres services de vérification des faits comme celui réalisé par nos confrères de VRT NWS CHECK, d’AFP Factuel mais aussi sur celui de confrères du réseau Spotlight de l’Eurovision, dont la RTBF est membre ou d’autres rubriques de fact checking reconnues. Il sera régulièrement mis à jour.

Voici une liste et un résumé de certains de ces narratifs fallacieux qui ont déjà pu être analysés depuis le début de la guerre. Les plus récents se trouvent au-dessus. Vous pouvez cliquer sur le thème de votre choix pour accéder directement au fact checking souhaité dans ce menu :

Fausses informations sur la guerre au Moyen-Orient

Cliquez sur le chapitre de votre choix pour y accéder directement

- L’image d’un missile rose associé à l’Iran a été générée par l’IA

- Une prétendue photo d’un aviateur américain secouru en Iran générée par IA

- Une image manipulée (par IA ?) de l’ayatollah Mojtaba Khamenei sur un lit d’hôpital

- Une vidéo de nombreux navires en attente près du détroit d’Ormuz générée par IA

- Des images supposées illustrer la mort de Benjamin Netanyahou et des accusations d’utilisation d’IA

- Des silhouettes d’avions de chasse iraniens supposément peintes au sol pour tromper l’ennemi

- Des images satellites truquées avec de l’IA

- L’explosion dans une base militaire américaine en Irak augmentée par IA

- Un pilote d’avion qui échappe à des missiles : des images issues d’un jeu vidéo

- Le Burj Kalifa de Dubaï n’a pas été touché suite aux attaques iraniennes

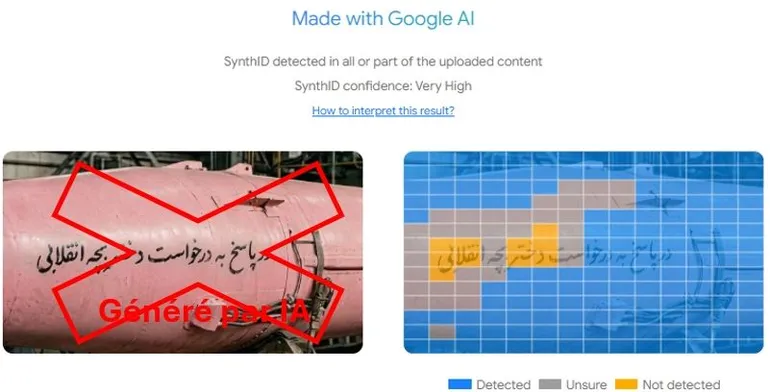

L’image d’un missile rose associé à l’Iran a été générée par l’IA

L’image du missile rose publié sur les réseaux sociaux a été détectée comme ayant été créée à l’aide de Google AI par l’outil SynthID. © RTBF

Alors qu’un cessez-le-feu de deux semaines au Moyen-Orient tétaient en vigueur et que les États-Unis maintenaient un blocus dans le détroit d’Ormuz. La veille de cette trêve temporaire, le 6 avril dernier, une image représentant un missile rose a circulé sur les réseaux sociaux, accompagnée d’une affirmation selon laquelle il aurait été fabriqué pour répondre à la demande d’une jeune Iranienne qui aurait souhaité qu’il soit tiré sur Israël. Une image relayée notamment par l’ambassade iranienne en Afrique du Sud sur son compte X.

Il s’agissait cependant d’une fausse information : cette image a été créée à l’aide de l’intelligence artificielle (IA) comme cela a pu être prouvé par l’AFP qui a notamment utilisé le logiciel de détection des outils de génération d’image réalisé à l’aide des outils d’IA de Google, SynthID. L’image a clairement été reconnue par l’outil qui a identifié cette image du missile rose comme « réalise avec Google AI ».

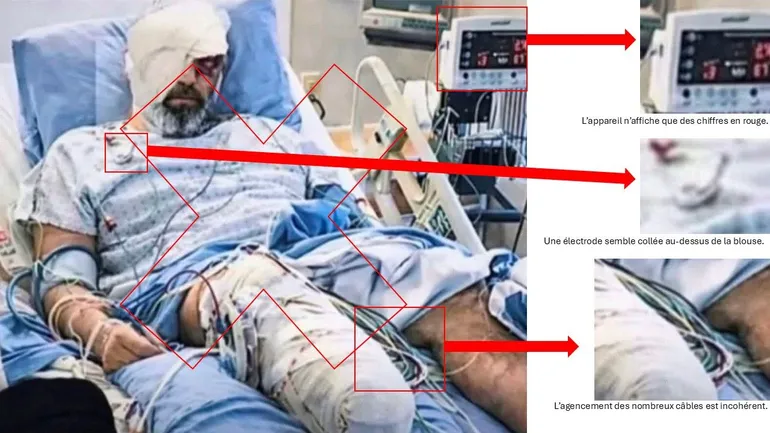

Une prétendue photo d’un aviateur américain secouru en Iran générée par IA

Des incohérences visuelles prouvent que l’image de ce pilote américain a été générée par IA. © AFP Factuel / RTBF

Après le crash de leur avion en Iran début avril, deux militaires américains ont été secourus lors d’une opération militaire organisée par les États-Unis sur le sol iranien. Sur les réseaux sociaux, une photo censée montrer l’un d’eux souriant, portant un drapeau américain et entouré d’autres militaires, a largement circulé.

Des personnalités publiques comme le procureur général du Texas, Ken Paxton, ainsi que le député républicain Mike Lawler ont eux aussi partagé cette image, présentée comme celle de l’aviateur secouru. Mais cette image a en réalité été générée par intelligence artificielle (IA), comme l’ont démontré nos confrères d’AFP Factuel.

Des experts ont pu analyser par exemple que le drapeau américain visible sur l’image présente également une anomalie : une bordure blanche apparaît à gauche du rectangle contenant les 50 étoiles. Une incohérence dans les couleurs des sangles de l’uniforme du militaire a été également mise en évidence par le chercheur Matthew Stamm, interrogé par l’AFP.

Une image manipulée (par IA ?) de l’ayatollah Mojtaba Khamenei sur un lit d’hôpital

© Capture d’écran X / RTBF

Sur le réseau social X, une photo présentée comme étant celle de l’ayatollah Mojtaba Khamenei sur un lit d’hôpital et amputé de la jambe droite a fait des millions de vues.

Mojtaba Khamenei a été élu guide suprême iranien le 8 mars 2026. Il a succédé à son père Ali Khamenei, tué au premier jour de l’attaque lancée par les États-Unis et Israël le 28 février contre l’Iran, entraînant une nouvelle guerre au Moyen-Orient.

Le nouvel ayatollah aurait été blessé durant le raid qui a tué son père, mais les détails sur la gravité de ses blessures ne sont pas connus et il n’est pas apparu en public depuis. Cette absence alimente des spéculations, notamment sur les réseaux sociaux.

L’image de faible qualité publiée sur X présente de nombreuses incohérences visuelles et a probablement été générée à l’aide d’un outil d’intelligence artificielle générative, sans que les outils de détection puissent être formels.

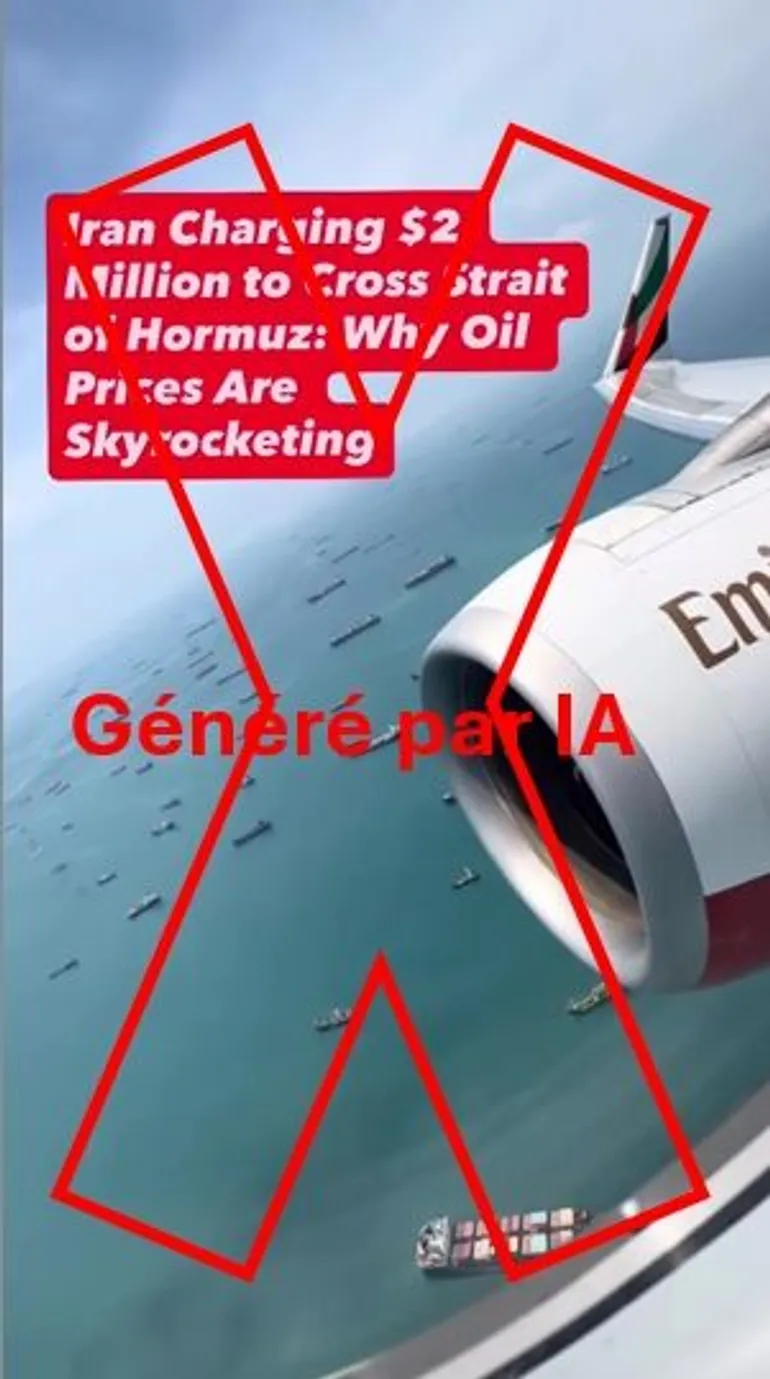

Une vidéo de nombreux navires en attente près du détroit d’Ormuz générée par IA

© Capture d’écran Instagram

Depuis un avion de la compagnie Emirates, un passager filme une multitude de navires en attente à proximité du détroit d’Ormuz, près de l’Iran. Ces images sont supposées illustrer la situation du blocage de ce point de passage stratégique du commerce maritime et indique que l’Iran ferait payer « deux millions d’euros pour le passage » de chaque bateau.

Comme l’indiquent nos confrères de NWS Check de la VRT, la vidéo, qui a déjà été visionnée plus de 11 millions de fois sur Instagram depuis sa mise en ligne le 24 mars 2026 a été réalisée à l’aide d’intelligence artificielle. L’image s’inspire néanmoins d’une véritable vidéo tournée depuis les côtes de Singapour.

Le compte qui a publié la vidéo se présente comme un « créateur de contenu IA ». D’autres vidéos du même type ont été postées sur la même page avec le logo d’une autre compagnie aérienne, par exemple.

Par ailleurs, la vidéo contient le filigrane SynthID laissé par les logiciels d’IA de Google. Une preuve irréfutable que le contenu a été généré à l’aide d’outils d’intelligence artificielle.

Des images supposées illustrer la mort de Benjamin Netanyahou et des accusations d’utilisation d’IA

© Capture d’écran X / RTBF /

Des images crées avec de l’IA illustrent la fausse mort de Benjamin Netanyahou. Élément en rouge ajoutée par la RTBF.

Le 12 mars 2026, le Premier ministre israélien Benjamin Netanyahu a fait sa première allocution depuis le début de l’offensive israélo-américaine contre l’Iran (ndlr : commencée le 28 février). Ces plusieurs jours d’absence médiatique, alors que son pays est en pleine opération militaire dans la région, ont poussé des internautes à affirmer que le dirigeant israélien serait mort.

Après cette apparition officielle, des internautes ont mis en doute l’authenticité des images relayées par certains médias : d’après eux, l’extrait diffusé serait une vidéo générée par IA car le dirigeant israélien aurait « six doigts » visibles sur certains plans (lien archivé ici).

© AFP / Capture d’écran prise le 16 mars 2026 sur X. Croix rouge ajoutée par l’AFP.

Pour rappel, les mains déformées par les IA génératives – notamment avec six doigts – figuraient parmi les anomalies les plus fréquentes permettant de détecter l’usage de l’IA générative grand public à ses débuts en 2023-2024 dans la foulée du lancement de ChatGPT. Des anomalies de ce genre peuvent encore apparaître mais sont de moins en moins fréquentes à mesure que les logiciels d’IA génératives se perfectionnent.

L’analyse de Lead Stories indique clairement que les images ne montrent pas que Benjamin Netanyahu a six doigts à la main droite mais qu’il s’agit de l’ombre de la paume de sa main. Elle corrobore l’analyse de l’AFP qui a identifié qu’il n’y avait bien que cinq doigts à la main droite du Premier ministre israélien sur les images de l’allocution.

Une vidéo de démenti qui ne fait que relancer les suspicions

Quelques jours plus tard, une vidéo de démenti est pourtant publiée sur le compte X du Premier ministre israélien. Dans celle-ci, on voit Benjamin Netanyahu dans un café près de Jérusalem, plaisantant sur les rumeurs concernant sa mort et même sur le nombre de ses doigts (liens archivés ici, ici et ici).

Mais, là encore, cette vidéo publiée le 15 mars est massivement partagée et commentée par des internautes persuadés d’y voir un nouveau faux, lui aussi généré par IA. En réalité, ces images n’ont vraisemblablement pas été générées par intelligence artificielle, comme le montrent des vérifications menées par l’AFP et des entretiens avec des spécialistes des contenus générés par IA même si de l’IA est bien utilisée actuellement par un bon nombre d’appareils de captures d’images comme les smartphones récents.

Des images de sa mort effectivement générées par IA

Plusieurs publications ont été diffusées sur les réseaux sociaux en parallèle des questions sur l’utilisation de l’IA dans la séquence au café. Des images censées montrer le corps de Benjamin Netanyahu être extrait de décombres après un bombardement présumé deviennent virales.

Nos confrères de la ZDF ont retrouvé plusieurs versions de courtes vidéos ou de photos censées montrer Netanyahou en train d’être secouru par des soldats ou des secouristes dans sa résidence détruite. Ces images circulent sur diverses plateformes telles que X, TikTok ou Instagram, où elles touchent des millions d’utilisateurs. Une analyse réalisée avec l’outil ImageWhisperer a permis d’identifier que les deux images (1 et 2) étaient probablement générées à l’aide d’IA avec un taux de confiance élevé.

Ce 19 mars, Benjamin Netanyahu a été vu par des journalistes lors d’une conférence de presse, où il a évoqué les rumeurs concernant sa mort : « Avant toute chose, je tiens à dire que je suis vivant, et vous en êtes tous témoins », a-t-il déclaré. La présence de la presse et les images tournées par CNN lors du questions-réponses avec le journaliste de la chaîne états-unienne, Jeremy Diamond permettent d’écarter avec certitude la théorie de la mort du dirigeant israélien.

Des silhouettes d’avions de chasse iraniens supposément peintes au sol pour tromper l’ennemi

© Capture d’écran Instagram / Une image supposée montrer que les États-Unis ont vidé des avions Iraniens dessinés au sol pour tromper l’adversaire.

Des images satellites, censées montrer que des avions israéliens et américains avaient ciblé la silhouette peinte d’un appareil au sol en Iran, tandis que Téhéran aurait déplacé de véritables avions ailleurs ont circulé.

Des publications incluent ce qui semble être une image satellite d’un aérodrome montrant un cratère de bombe flanqué de deux silhouettes peintes ressemblant à des avions militaires. Plusieurs versions de ce narratif ont été publiées en ligne (comme ici et ici) autour des 5 et 6 mars 2026.

L’image, partagée sur Facebook et Instagram, présente des signes évidents de manipulation, notamment des coordonnées incompréhensibles sur les bords comme l’indique l’AFP.

Des images satellites truquées avec de l’IA

© Capture d’écran X / RTBF / Capture d’écran d’une image avant/après manipulée à l’aide d’IA, les indications en rouge ont été ajoutées par nos soins.

Le Tehran Times, un quotidien anglophone iranien, a publié sur X une image « avant/après » censée montrer des équipements radar américains « complètement détruits » sur une base au Qatar. L’image truquée a cumulé des millions de vues et s’est propagée sur les réseaux sociaux dans plusieurs langues.

Les analyses de l’AFP et de BBC Verify indiquent que ce faux semble s’inspirer d’une véritable image satellite d’une base navale américaine à Bahreïn, prise en février 2025, qui est accessible au public sur Internet via Google Earth.

Parmi les indices visuels qui ont permis de détecter la manipulation, des voitures se retrouvaient positionnées aux mêmes emplacements sur la photo satellite authentique et sur l’image retouchée. Nos confrères de Lead Stories ont également étudié l’apparition improbable de deux structures supplémentaires dans l’image montrant « l’après bombardement » ainsi que d’autres éléments créés. L’AFP a par ailleurs détecté sur cette image un « SynthID« , un filigrane invisible identifiant un contenu généré par IA.

Si les deux images avaient été prises dans un intervalle de temps aussi court que les voitures auraient pu se retrouver exactement aux mêmes endroits, des bâtiments supplémentaires n’auraient pas pu être érigés dans le même intervalle de temps.

Ces images satellites fabriquées surgissent après l’apparition de faux comptes de renseignement de sources ouvertes (OSINT) sur les réseaux sociaux, qui semblent vouloir saper le travail de spécialistes reconnus du numérique.

L’explosion dans une base militaire américaine en Irak augmentée par IA

© Capture d’écran X / L’image de droite (publiée sur X) montre l’aéroport international d’Irbil touché par un bombardement le 1er mars en Irak. Elle a été augmentée avec de l’IA, à gauche.

Le 2 mars, une image prétendant montrer une énorme explosion dans une base militaire américaine en Irak a été analysée par nos confrères de BBC Verify et de AFP Factuel. Elle a été publiée alors que des drones ciblaient une base américaine située près de l’aéroport de la capitale de la région semi-autonome du Kurdistan irakien.

Selon l’analyse de la BBC, cette fausse image semble être basée sur une photo réelle qui a été partagée pour la première fois en ligne le dimanche 1er mars. Celle-ci montrait un nuage de fumée s’élevant au-dessus de l’aéroport international d’Erbil. Elle a ensuite été manipulée à l’aide de l’IA.

Si un journaliste AFP a bien confirmé avoir entendu de fortes explosions et vu une épaisse fumée noire s’élever de la zone de l’aéroport, cette image est trompeuse : elle a été modifiée à l’aide de l’intelligence artificielle (IA), aggravant l’ampleur des dégâts.

L’image falsifiée présente des incohérences visuelles, notamment une boule de feu irréaliste et des structures de forme inhabituelle sur le côté droit qui n’apparaissent pas sur les photos récentes prises à cet endroit. Le détecteur de filigrane SynthID de Google a confirmé qu’elle avait été générée ou modifiée à l’aide de l’IA de Google.

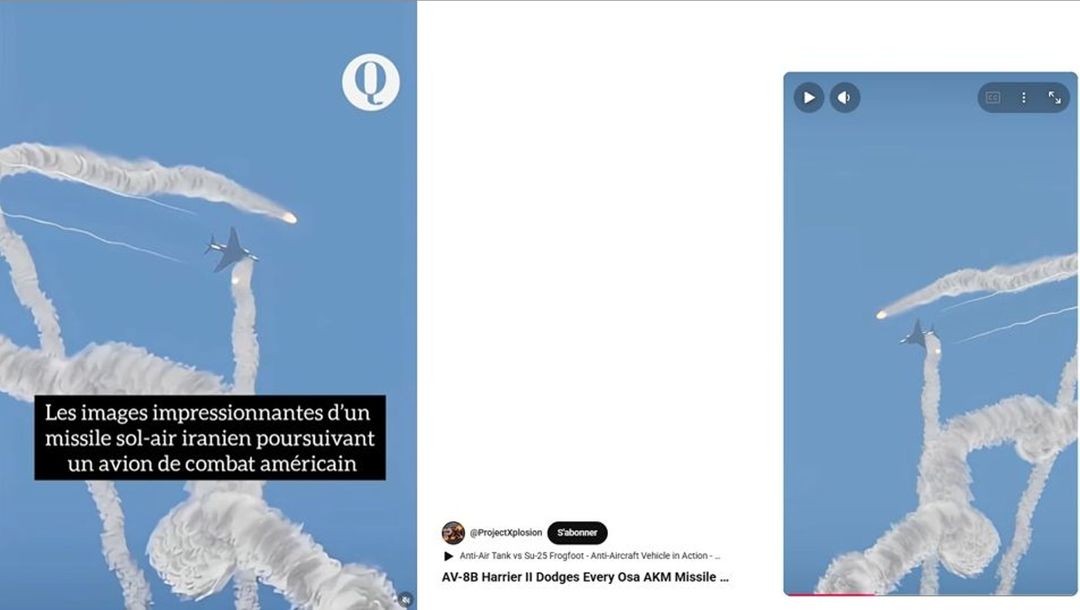

Un pilote d’avion qui échappe à des missiles : des images issues d’un jeu vidéo

© Capture d’écran Instagram / Youtube / La vidéo à l’origine de « reel » sur Instagram est un « short » contenant des images de DCS World.

Une vidéo montrant les prouesses du pilote d’un avion de combat américain a fait des millions de vues sur Instagram.

La publication, mise en ligne peu de temps après le début de la nouvelle guerre au Moyen-Orient, utilise des images d’un compte qui publie des shorts sur Youtube.

Dans ce cas, il ne s’agit pas d’images générées par IA mais bien d’images d’un jeu.

En effet, les « shorts » issus de Youtube sont des images de simulation d’avions tirées du jeu vidéo Digital Combat Simulator (DCS World). L’axe des vidéos a été inversé horizontalement avant leur publication sur Instagram. Elles sont fausses et n’ont donc aucun lien avec la guerre entre les États-Unis, Israël et l’Iran.

D’autres images issues de jeux vidéo ont été utilisées pour désinformer les utilisateurs des réseaux sociaux dans le cadre de la guerre. C’est notamment le cas d’une vidéo d’un missile frappant un navire américain issue du jeu War Thunder ou des images d’un autre avion poursuivi par des missiles sol-air, issues du même jeu de simulation de guerre.

Le Burj Kalifa n’a pas été touché par des missiles iraniens

© Captures d’écran réseaux sociaux / Des images générées par IA montrent des missiles percuter le Burj Khalifa de Dubaï.

Des vidéos diffusées sur Youtube indiquent que le célèbre Burj Khalifa, la plus haute tour du monde, a été frappé par des drones ou des missiles iraniens suite aux attaques conjointes menées par les États-Unis et Israël depuis le 28 février contre l’Iran.

Dans une publication sur Instagram, un énorme obus détruit le célèbre gratte-ciel. Sur d’autres images qui circulent en ligne, comme sur YouTube, on voit la plus haute structure humaine jamais construite s’écrouler après avoir été touchée par un missile lancé sur le sommet de la tour. Comme l’ont analysé nos confrères de Check de la VRT, ces vidéos ont été générées à l’aide d’intelligence artificielle.

Par ailleurs, si de la fumée bien a été aperçu autour de l’immeuble le 28 février, que des images montrent des interceptions de drones « à proximité » du Burj Khalifa et que le Burj Al Arab a bien été victime d’un incendie le 28 février 2026, le Burj Khalifa n’a jusqu’ici pas été touché.

Le risque d’impacts bien réels : influencer l’opinion publique ou les marchés financiers

« Les images satellites manipulées, comme d’autres formes de désinformation, peuvent avoir des impacts bien réels lorsque des personnes agissent sur la base d’informations qu’elles n’ont pas vérifiées », souligne Brady Africk à l’AFP. « Ces effets peuvent aller de l’influence sur l’opinion publique sur une question majeure, comme la décision d’un pays d’entrer en conflit ou non, à l’impact sur les marchés financiers ».

À l’ère de l’IA, des images satellites authentiques, en haute résolution et collectées en temps réel, peuvent fournir aux décideurs des indices essentiels pour évaluer les menaces sécuritaires et réfuter les contrevérités provenant de sources non vérifiées.

« Lorsqu’une image satellite est présentée comme preuve visuelle dans un contexte de guerre, elle peut facilement influencer la manière dont les gens interprètent les événements », a également déclaré à l’AFP le spécialiste de la désinformation géographique, Bo Zhao, de l’université de Washington.

À mesure que les images générées par IA deviennent de plus en plus convaincantes, il est « important que le public aborde ce type de contenu visuel avec prudence et avec une vigilance critique », insiste Bo Zhao.